Am Wochenende ging in zweierlei Hinsicht eine Art digitaler Aufschrei durch Twitter, dessen Nachhall noch immer durch die Timelines vibriert. Genau genommen geht es um Big Data Analysen, die (möglicherweise) Präsidenten hervor oder zu Fall bringen können und um den Entwurf einer Charta der digitalen Grundrechte, welche mit Verve und prominenter Unterstützung bereits den ersten Schritt in die europäische Gesetzgebung gegangen ist. In dem Zusammenhang geht es dann natürlich auch um die bestehenden wie kommenden (europäischen) Datenschutzregelungen und vor allem darum, was das eine mit dem anderen zu tun hat sowie warum möglicherweise hier eine ganze Menge zu tun ist, dort aber vielleicht doch besser gar nichts getan werden sollte.

Doch der Reihe nach. Von vorne. Und im Einzelnen.

Big Data Analysen

In Sachen Big Data Analysen gab es am Wochenende reichlich zu staunen. Der Artikel „Ich hab nur gezeigt, dass es eine Bombe gibt“ ging nämlich derart durch die Timelines, dass ich schon dachte, dieser sei mit Millionen gesponsert. Doch nein, der Artikel, der – kurz zusammengefasst – die Geschichte eines Psychologen erzählt, welcher eine Methode fand, anhand derer das Verhalten von Menschen in den sozialen Medien analysiert und zu (Wahl)-Werbezwecken ausgeschlachtet genutzt werden kann, ist von einem Schweizer Magazin geschrieben und ins Netz gestellt worden. Offenbar triggerte die Vorstellung, dass Wahlen durch Big Data Analysen bis hin zur Wahl oder Nicht-Wahl einzelner Personen beeinflusst werden könnten, ganz mächtig. So mächtig, dass ich mir die Augen kräftig rieb.

Zum einen, weil der Artikel insbesondere von Menschen mit Entsetzen geteilt wurde, von denen ich sonst eher hörte, Datenschutz sei grundsätzlich erstmal ganz schön innovationsfeindlich und dass man doch „sowieso nichts zu verbergen“ habe. Und nun mit einmal „Huch! Das ist ja schrecklich!“ Ach ja. Huch? Vielleicht doch nicht so cool, dieses bedingungslose „Ich hab nichts zu verbergen – da kann ruhig jeder alles wissen!“, wenn man das Thema einmal unter einer solchen Perspektive präsentiert bekommt?

Zum anderen, weil das Ganze dem Grunde nach nun überhaupt gar nicht neu ist. Bereits 2014 (!) beschäftigte ich mich zusammen mit Joachim Diercks (seines Zeichens Geschäftsführer der Firma CYQUEST und Kopf des Recrutainment-Blogs) mit der eben jetzt durch die Timelines gewirbelten Big Data Analyse bzw. Diagnostik der University of Cambrigde; damals im Zusammenhang mit der Frage „Warum zu viel Big Data Ihrer Arbeitgeber-Marke schadet„. Das heißt, wir beleuchteten für die Lead Digital, warum Big Data Analysen basierend auf Social Media aus rechtlicher und eignungsdiagnostischer Sicht nur unter Einschränkungen zu empfehlen sind. Dazu passt der Artikel Persönlichkeitseigenschaften mit Facebook-Likes vorhersagen? Echt jetzt? von Lars Fischer, der sich bereits im Jahr 2013 (!) mit dem Modell aus Cambridge und der Rolle der Statistik befasst. Soweit also an sich nichts Neues.

Der Journalist Dennis Horn hat aber aufgrund des aktuellen Aufschreis diese Kritik noch einmal in dem Artikel „Hat wirklich der große Big-Data-Zauber Trump zum Präsidenten gemacht?“ leicht verständlich zusammengefasst. Dabei zeigt er vor allem auch auf, dass der vorgenannte „Bomben-Artikel“ vielleicht zuallererst mit einem kritischen Auge gelesen werden sollte, bevor man sich der digitalen Untergangsfantasie (schon jetzt) gänzlich hingibt. Zum einen aufgrund der Tatsache, dass der eben genannte Artikel so ganz stimmig nicht ist, wie das geschulte Auge erkennt. Und zum anderen, da es eben – wie gesagt – doch nicht ganz so einfach ist, Wähler (oder Bewerber) mal eben auszurechnen.

[Wer nun noch nicht genug vom Hintergrundwissen hat , der möge weiter bei Jens Scholz vorbeischauen. Und wer die Nerven hinsichtlich einer möglichen Wahlbeeinflussung der Bundestagswahl 2017 beruhigen möchte, der lese Nach Cambridge Analytica: Vom kleinen Big Data deutscher Parteien von Matthias Richel, der auf das Schönste vor Augen führt, warum derartige Big Data Analysen deutschen Parteien, selbst wenn sie noch so sehr wollten, (derzeit) nicht so richtig zur Verfügung stehen.]

Tja. Nun mag sich so mancher treue Leser die Augen reiben. Und fragen, ob er im richtigen Blog, bei der richtigen Autorin gelandet ist. Big Data Analysen? Alles kein Problem? Und das von Rechtsanwältin Diercks? Gemach. Gemach. Ich wollte hier zunächst nur den Rahmen zu Big Data Analysen aufziehen. Und der lautet erst einmal: Es geht schon eine ganze Menge. Technisch. Und es wird genutzt. Dass die Ergebnisse möglicherweise noch etwas unschärfer sind, als es diejenigen behaupten, die damit Geld verdienen – geschenkt. Denn davon abgesehen, dass immer schneller immer mehr Datenmengen verarbeitet werden können, die Algorithmen besser, falsche Korrelationen weniger und womöglich Kausalzusammenhänge konkreter werden, kann wohl unbestritten das Folgende gesagt werden: Wer Big Data Analysen im Wahlkampf (oder Recruiting) zum besseren Micro-Targeting einsetzt, der … kann damit wohl schon eine ganze Ecke (mehr als der Mitbewerber) erreichen.

Wenn die Technologie aber da ist, natürlich genutzt wird und Technologie per se natürlich nicht böse ist, müsste dann nicht viel mehr danach gefragt werden, wie Big Data Analysen genützt werden dürften? Mit welchen Daten? Zu welchen Zwecken? In welchem Ausmaß?

Ja, klar! Aber dafür gibt es doch Datenschutzgesetze.

Das sollte man meinen. Und natürlich gibt es das Bundesdatenschutzgesetz (BDSG) sowie ab 2018 die EU-Datenschutzgrundverordnung (DSGVO).

Das Problem ist bloß: Weder das eine noch – so sehr es schmerzt und verwundert – das andere liefern hier Antworten oder gar auch nur Regelungen, anhand derer Big Data Analysen, wie den oben genannten, ein (auch nur halbwegs) klarer Rahmen gesetzt werden könnte.

Weiß man um die Entstehungsgeschichte und das Alter des BDSG mag das kaum verwundern. Es entstammt ursprünglich den 90ern und Big Data Analysen wie wir sie heute kennen, waren damals noch nicht am Horizont ersichtlich. Man kann Big Data Analysen unter das BDSG subsumieren und deren Zulässigkeit bewerten. Mit Hilfe der Scoring-Regelung, der Regelung zu allgemein zugänglichen Daten und einer ganzen Menge juristischer Herumturnerei.

[Wer es hier genauen wissen möchte, der sei an dieser Stelle auf die Blogartikel Big Data, Scoring & Recht – Teil 1: Grundlagen sowie Big Data, Scoring & Recht – Teil 2: Ein Praxisbeispiel aus dem HR-Bereich verwiesen. Und wem in den vorgenannten Artikeln die harte juristische Substanz fehlt und wer es gerne wissenschaftlich aufbereitet hätte, der kann einen Blick in die PinG, 01/16, S. 30 werfen: Big Data-Analysen & Scoring in der (HR-)Praxis – Dürfen aus allgemein zugänglichen personenbezogenen (Arbeitnehmer-)Daten Score-Werte erstellt und genutzt werden? ]

Angesichts der Tatsache, dass aber eben solche Anaylse-Methoden zusehends in allen nur erdenklichen Bereichen und mit einem heute möglicherweise, bald jedoch definitiv massiven Impact eingesetzt werden, kann es nicht sein, dass das Recht hierfür keine Antworten hat. So wenig der Artikel zur „Bombe“ der Big Data Analyse in seinen Einzelheiten stimmen mag, so klar zeigt er doch einer breiten Masse auf, auf welchem Weg die Algorithmen sind. Vor diesem Hintergrund darf zweierlei nicht sein:

- Dass es keine klaren Regelungen, Prüfschemata und Bewertungsmöglichkeiten für die Zulässigkeit von Big Data Analysen gibt. (Welche Daten dürfen aus welchen Quellen zur Analyse erhoben werden, zu welchen Zwecken darf ausgewertet werden und wo sind absolute Grenzen?)

- Dass selbst, wenn es diese Regelungen gäbe, keine Exekutive für die Durchsetzung dieser Regelungen verantwortlich ist oder aber qua absoluter Mangelausstattung nicht in der Lage ist, die ihr übertragen Aufgaben wahrzunehmen.

Auch der Blick in die nahe Zukunft schafft hier keine Abhilfe. Die DSGVO steht Big Data Analysen nämlich genauso hilflos, wenn nicht gar noch hilfloser, gegenüber als es das BDSG tut. Ja, die DSGVO hat das sogenannte Profiling definiert (was letztlich Big Data Analysen darstellen kann). Das ist gut. Geregelt wird es jedoch ausschließlich im Zusammenhang mit automatisierten Entscheidungen, die der betroffenen Person gegenüber rechtliche Wirkungen entfalten. Das ist schlecht. Sehr schlecht.

Denn Big Data Analysen werden oftmals eben gerade nicht zur automatisierten Herbeiführung rechtlich verbindlicher Entscheidungen verwendet. Sondern zur Vorbereitung menschlicher Entscheidungen. Wie etwa der Entscheidung, welcher Kandidat von einem Unternehmen angesprochen werden sollte. Oder welcher Mitarbeiter von seinem Arbeitgeber. Oder der Entscheidung, welche Partei gewählt werden sollte.

Hierzu sagt die DSGVO wiederum: Nichts. Nein, also, natürlich, sie sagt nicht nichts. Auch hier können mit mühevoller juristischer Rumturnerei Ergebnisse erzielt werden. Über die bis zum Exzess gestritten werden kann.

[Wer es hier genauer wissen möchte, der möge bitte zum Artikel Big Data im Zeitalter der EU-Datenschutzgrundverordnung (DSGVO) – Teil 6 zur EU-DSGVO springen.]

Und eben deswegen nochmal: Will man sich angesichts dessen, welche Macht hinter Daten und Analysen stecken kann, darauf verlassen? Vor allem, wenn man weiß, wie falsch diese Macht sein kann? Nicht falsch im Sinne von „der Algorithmus ist böse“, sondern schlicht, weil ein Wahrscheinlichkeitswert eben nur eines ist: Ein Wahrscheinlichkeitswert. Und weil deswegen vielleicht die Berechnung bestimmter Wahrscheinlichkeitswerte aus bestimmten Daten und aus bestimmten Quellen untersagt werden sollte?

Ha! Sagt jetzt der eine oder andere Datenschützer zusammen mit der Frage „Was willst Du denn?! Big Data Analysen sind unter der DSGVO schlicht verboten. Und das ist auch gut so!“ – Diese Auffassung existiert. Diese Auffassung ist auf so vielen Ebenen falsch. Denn der DSGVO ist so klar eben gar nicht zu entnehmen, dass Big Data Analysen verboten sind. Es ist nur eben so kompliziert zu subsumieren wie unter dem BDSG und wird für genauso viel Uneinigkeit und Streit sorgen. Für viel schlimmer halte ich aber schon die Grundhaltung, dass Big Data Analysen aus allgemein zugänglichen Quellen schlicht zu verbieten seien. Auch wenn ein Teil der Datenschutzfraktion dies über das Argument des „Der User kann sich nicht vor sich selber schützen, er kann keine informationelle Selbstverantwortung ausüben – das müssen wir schon so vollumfänglich machen, dass wir jedwede Datenanalysen, vor allem aus allgemein zugänglichen Quellen, verbieten“ in dieser Absolutheit vertritt. Ich frage mich immer: Warum wird dem Nutzer per se seine Mündigkeit abgesprochen? Und warum wird per se eine Technologie verteufelt? Es ist eine Technologie. Ja. Sie wird genutzt. Und sie wird sich nicht wieder in die Büchse der Pandora stopfen lassen. Also braucht es belastbare und durchsetzbare Regeln. Anders ausgedrückt: „Das Recht auf informationelle Selbstbestimmung und vor allem informationelle Selbstverantwortung braucht einen entsprechenden Rahmen, in dem dieses vom einzelnen Nutzer wirksam ausgeübt werden kann“ (Ja, das hat irgendwer gerade auch so ähnlich oder jedenfalls sinngemäß gesagt, es lief durch meine Twitter-Timeline. Ich weiß bloß nicht wer. Wer mir einen Hinweis geben mag… dem ist mein Dank geschuldet.)

Dieser Rahmen zu Big Data Analysen fehlt. Und er ist eben auch nicht, jedenfalls keinesfalls hinreichend, in der DSGVO abgebildet. Ob man will oder nicht. Das wird noch für Schmerzen sorgen. Und das gilt selbst dann, wenn es irgendwann herrschende Meinung wäre (Himmel, lass es beim Konjunktiv irrealis bleiben), dass Big Data Analysen, gleich welcher Art, schlicht verboten sind.

Die Charta der digitalen Grundrechte

Und damit sind wir nun endlich bei dem zweiten digitalen Aufschrei des Wochenendes, der #digitalcharta“ angekommen. Der unbefangene Leser mag nun denken, dass wir nun zur Lösung der hier skizzierten Probleme kommen. Denn „Charta der digitalen Grundrechte der Europäischen Union„, das klingt doch danach, als würde man sich genau um Fragestellungen wie die eben aufgeworfenen kümmern. Um Fragen des technischen Könnens und des ethischen Dürfens, um die Abwägung von Rechtspositionen im digitalen Zeitalter und dazu gleich noch um Fakenews und Hatespeech und um …

fügegedanklichlautquietschendesbremsgeräuschein

Nein! Also, ja. Ich bin mir sicher, dass es den Initiatoren mit den besten aller Absichten genau darum ging. Doch gut gewollt ist leider noch ganz lange nicht gut gemacht. Überhaupt nicht.

Es beginnt schon beim Titel. „Digitale Grundrechte“. Autsch. Bereits an dieser Stelle bekommt der Volljurist, Referendar, Jurist, Examenskandidat, Jura-Student im 2. Semester hektisch Flecken. Es gibt Grundrechte. Und die gelten umfassend. Digital wie analog. Entweder hab ich ein Grundrecht oder nicht. Meinungsfreiheit ist Meinungsfreiheit. Digital wie analog. Schon dieses Verständnis offenbart alles Unverständnis.

Doch wenn… es nur der Titel wäre! Es geht aber schlicht weiter mit abstrusem, jedwede juristischen Grundlagen und Zusammenhänge ignorierendem Unsinn. Er schreit dem Leser in den einzelnen Artikeln entgegen, die in sich unstimmig bis zum #ichmöchtemirdieHautaufkratzen sind. Und er verhöhnt den Betrachter, der versucht, diese Digitalcharta irgendwie in dem Kontext neben (unter? über?) anderer Normen wie etwa der Charta der Grundrechte der europäischen Union oder der Europäischen Datenschutzgrundverordnung zu sehen. Von nationalen Regelungen wie etwa dem Grundgesetz (ach, nicht so wichtig) gänzlich abgesehen.

Was ich damit meine? Ich könnte jetzt natürlich auch die Artikel zitieren, sie nebeneinander stellen und in Bezug zu grundlegenden Systematiken setzen. Aber das haben andere über das Wochenende, bzw. zu Beginn der Woche, schon in mühevoller Arbeit detailliert getan. Exemplarisch sei deswegen auf die folgenden Artikel verwiesen:

Fordern kann man viel… – zur sog. Charta für digitale Grundrechte von Arnd-Christian Kulow und Thomas Stadler – Die Autoren zeigen ebenso ausführlich wie gut verständlich auf, warum der Charta jedes verfassungsrechtliche Handwerkszeugs fehlt, warum der gewählte Entstehungsweg bei allen guten Absichten der Falsche ist und warum ein derartig erstellter, neuer Grundrechtskatalog keine Antworten auf die drängenden Fragen der digitalen Technologie bietet.

Unstable – Der Digitalcharta fehlt ihr Datenschutz-Fundament von Malte Engeler – Der Artikel setzt sich mit grundlegenden systematischen Fehlern und hier insbesondere mit den Regelungen der Artikel 11, 12 und 13, also Datenschutz, informationelle Selbstbestimmung und IT-Sicherheit auseinander.

Digitale Chartastimmung von Markus Kompa – In diesem Beitrag wird sich insbesondere mit der schiefen Konstruktion zur – digitalen – Meinungsfreiheit in Artikel 5 auseinandergesetzt.

KOMMENTAR ZUR DIGITALEN GRUNDRECHTE-CHARTA von Martin Rost – welcher sich insbesondere mit dem nicht vorhandenen „Verbot mit Erlaubnisvorbehalt“ befasst, was sich – aus gutem Grund – in allen sonstigen Gesetzen und Verordnungen findet.

Vielleicht kurz zur Frage der Big Data Analysen und der #digitalcharta, weil ich eben dieses Thema ja zuvor aufwarf. Artikel 6 (Profiling) und Artikel 7 (Algorithmen) lassen sich gut mit den Worten der fantastischen Vier beschreiben: Du redest laut, doch Du sagst gar nichts.

tl;dr: Dieser Entwurf ist Murks. Auf allen Ebenen und aus allen Perspektiven. Er hilft nicht. Und noch viel schlimmer. Der Entwurf wird der Diskussion um das Recht im digitalen Zeitalter einen Bärendienst erweisen.

Halt! Rufen lautstark die Initiatoren, zu denen, man (ich) mag es kaum glauben, neben Journalisten und Kommunikationswissenschaftlern auch namhafte Juristen zählen. „Hört ihr denn nicht? Es ist ein Entwurf! Alle sollen partizipieren, ein jeder soll an diesem großen zivilgesellschaftlichen Projekt mitarbeiten.“ So sinngemäß. Und ich fasse es immer weiter nicht. Warum? Was daran so schlecht ist, an einer Grundrechte-Charta, die von allen getragen wird? Das:

1) Ja, es ist eine gute Idee, Informatiker und Kommunikationswissenschaftler zu beteiligen. Nein, das entbindet die Juristen nicht davon, ihr Besteck auszupacken und (!) davon Gebrauch zu machen.

Natürlich ist es eine gute Idee, wenn sich nicht nur Juristen an einen Tisch setzen, um gesetzliche Regelungen für das digitale Zeitalter zu entwerfen. Die Expertise von Informatikern und Kommunikationswissenschaftlern ist natürlich einzuholen. Ein Grundverständnis von juristischen Zusammenhängen ist aber unabdingbar, um den Entwurf einer gesetzlichen Regelung zu erstellen, der dann erst sinnvollerweise diskutiert, ergänzt, angepasst und/oder gekürzt werden kann. Ja, ich weiß. Das Recht, das sind nur Worte. Und so glaubt zumeist der geneigte Journalist oder Kommunikationswissenschaftler, Jura sei für ihn nicht schwer. Mit Worten, damit könne er ja umgehen. Ja, richtig, mit Worten. Aber eben nicht mit Gesetzes- und Regelungssystematiken. Deswegen muss der Jurist die Expertise der anderen in den rechtlichen Kontext bringen.

Vielleicht wird es mit einem greifbareren Beispiel klarer: Der Mikrobiologe mag dem Arzt den entscheidenden Hinweis geben können, warum sich das immer wieder operativ entfernte Magengeschwür neu bildet. Der Arzt ist aber derjenige, der daraufhin eine weitere Operation durchführt und/oder die entsprechenden Medikamente verabreichen kann. Nicht der Mikrobiologe. Warum? Weil der Arzt die Auswirkungen von Operation und Medikamentengabe auf den menschlichen Körper einschätzen und absehen kann. Das kann der Mikrobiologe einfach nicht. Nicht im hinreichenden Maße. Woher auch. Muss er ja auch nicht.

Hier haben die Mikrobiologen die OP durchgeführt und vergeben den Medikamenten-Cocktail. (Fast) Alle Ärzte sind schockiert. Andere Mikrobiologen stimmen den die OP durchführenden Mikrobiologen zu. Aber eben nur die. Das sollte dem ausführenden Mikrobiologen-Team zu denken geben. Tut es aber nicht. Patient erleidet schlimme Komplikationen. „Ach, was soll’s! War ja nur ein Versuch! Bauen wir die Versuchsanordnung noch einmal neu auf“ – so der Mikrobiologe, während der Arzt um das Leben des Patienten ringt.

So verhält es sich hier. Man wird das Gefühl nicht los, dass die Verfasser selbst nicht begreifen, dass durch das Einbringen einer losen Versuchsanordnung in den Gesetzgebungsprozess etwas losgetreten werden kann (zugegeben, nicht muss), was nur schwer wieder einzufangen ist. Und man reibt sich die Augen, wenn ein Jurist und Volkswirt (wie ich erst heute lernte, erklärt hier vielleicht manches) und herausragender Datenschützer sagt „Hey, das ist nur ein Entwurf, den wir da einbringen. Ich weiß, dass er massive Schwächen hat, aber hey, ist nur ein Entwurf. Wir arbeiten noch dran.“ (So sinngemäß Peter Schaar gestern auf Twitter) Bitte?!

Warum bringt man einen so desaströsen, von nahezu allen Ärzten, äh, Anwälten, als schwer unheilbringend eingeordneten Entwurf in den ersten Schritt des Gesetzgebungsverfahrens!? Wann hat man schon mal gesehen, dass sich Juristen derart einig sind? Seit wann ist ein Gesetzgebungsprozess eine Spielwiese für Ideen? Und warum verschließt man Augen und Ohren vor all dieser mit Hand und Fuß geäußerten Kritik?

Weil man zu weit gegangen ist? Weil man sich die Reaktion anders vorgestellt hat? Weil man nicht zurück kann? Weil man nur eine „Diskussion“ anstoßen wollte? Wenn das der Fall ist, heißt das, jeder bringt jetzt lustige Gesetzesentwürfe mit Hilfe einer PR-Agentur in den Gesetzgebungsprozess, damit das mal „diskutiert“ wird?!

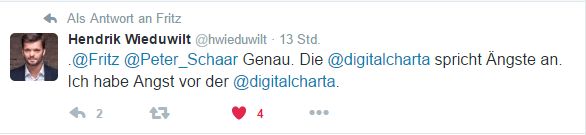

Der Jurist und Legal Affairs Corespondent der FAZ Hendrik Wieduwilt schrieb (sehr viel lesenswertes) dazu auf Twitter, unter anderem dies:

Und offensichtlich ist einer der Favs von mir. Mir geht es auch so. Und damit kommen wir zu Punkt zwei und drei.

2) „Wenn viele zusammen an einer Sache arbeiten, dann ist das gut, Intelligenz ist dabei nicht zwangsläufig im Spiel“

Ja, dieser Satz stammt von einem der Initiatoren selbst. Sascha Lobo schrieb ihn. In seinem Spiegel-Online-Kommentar „Den Schwarm interessiert nur das Ergebnis„. Der Satz ist an sich sehr alt. Er hieß einmal „Zu viele Köche verderben den Brei“. Da war schon immer etwas dran. Und deswegen glaube ich auch nicht an eine heilsame Entwicklung des Entwurfs durch Partizipation.

Auch, wenn es vielen nicht schmeckt. Es hat einfach einen Sinn, dass Gesetze, Verordnungen etc. pp. – nachdem die Leitlinien und Grundsätze besprochen sind – zunächst einmal im kleinen Kreis von ausschließlich mit der Materie befassten Beamten und einigen zugezogenen Fachexperten diskutiert und entworfen werden. Das ist einfach schwere Kost und schwere Arbeit. Die kann man hinterher kritisieren. Wichtig ist jedoch, dass eine Basis steht, mit der gearbeitet werden kann. Das ist hier nicht ersichtlich.

Oh! Ah! Schreien nun die Befürworter. Ha! Das ist doch bei diesen Geheimakten auch oft so. Da muss man sich doch nur Acta & Co angucken. Da sieht man ja, was bei der Klüngelei herauskommt! – Nein, eben nicht. Natürlich kann und muss man Gesetzesentwürfen kritisch gegenüberstehen. Was aber heutzutage regelmäßig passiert, ist das, was Sascha Lobo in seinem obigen Artikel aufgegriffen hat. Gesetzesentwürfe werden von der (digitalen) Masse zerrissen. Es wird polarisiert und protestiert – ohne eine einzige Primärquelle gelesen zu haben. Ohne ein Grundverständnis der Materie entgegengebracht zu haben. Warum auch, es gibt doch Twitter und Facebook. Und da sagen Leute mit echt vielen Followern, dass das alles Sch*** ist. Kurz: Es gibt nicht nur Schwarmintelligenz, sondern auch die sich in Echokammern selbst verstärkende Schwarmdummheit (das dürfte seit der US-Wahl wohl jedem eingängig sein). Am Beispiel von ACTA hatte ich die Auswirkungen von Schwarmdummheit 2012 einmal skizziert.

Hier befürchte ich, dass gerade aufgrund der großangelegten begleitenden PR eben diese Schwarmdummheit zuschlägt, bevor ein ernsthaft besprechbarer Entwurf überhaupt einmal sinnvoll zustande gekommen ist. Schon jetzt scheint eine Sachdiskussion nicht gewünscht zu sein. Denn auf die Sachargumente wurde bislang von Seiten der Initiatoren nicht eingegangen. Ich kann die Stelle jedenfalls nicht erkennen (Nun, angeblich sind die Kritiken in Brüssel „mit eingereicht“ worden und werden vom Team der digitalcharta „bewertet“ – was auch immer das heißen mag. So heißt es jedenfalls heute auf der Seite der Digitalcharta) .

3) Partizipation – war das je wirklich gewollt? Und wenn ja, wie soll das gehen?

Der Entwurf ist am 30.11.2016 veröffentlicht worden. Und zwar mit mächtig medialem Druck. Schließlich sind unter anderem die ZEIT und Springer unter den Initiatoren. Schnell war klar, dass das Ganze bereits am 05.12.2016 vor dem Ausschuss für bürgerliche Freiheiten, Justiz und Inneres vorgestellt werden sollte. Dazwischen lag ein Wochenende. An diesem Wochenende haben sich zahlreiche Menschen, nachdem sie den Herzinfarkt herunterschluckten, hingesetzt und fundierte Kritiken geschrieben. Doch… es schien bis gestern, als sei das nicht von Belang. Nun ist das Vorstellen eines Entwurfs in einem Ausschuss naturgemäß nur der erste kleine winzige Schritt an die Türschwelle des Gesetzgebungsverfahrens. Da wird nicht morgen über das Inkrafttreten abgestimmt. Aber es ist der erste Schritt. Bei dem Zeitfenster drängt sich jedoch der Eindruck massiv auf, dass es nie um Partizipation ging, sondern um PR. Nun ja, das jedenfalls ist gelungen.

Aber! Aber! Wieder soweit alles falsch. Schließlich sei natürlich die Partizipation damit nicht abgeschlossen. Sie beginne doch gerade erst! In der Öffentlichkeit wie im Parlament.

Doch ach, auch das ist eine gute Idee. Aber wie soll denn dieser handwerklich schlechte Entwurf sinnvoll zur Diskussion in die Öffentlichkeit gestellt werden? Wer in der großen Masse mag sich denn mit den komplexen Problemen, die die Kollegen im Einzelnen aufgeführt haben, wirklich auseinandersetzen? Wie soll es „öffentlich“ und (!) „parlamentarisch“ diskutiert werden?

Und wie wird das Problem der Schwarmdummheit verarbeitet? Auch, wenn ich dafür verhauen werde, mir ist unklar, wie es hier auch nur im Ansatz funktionieren soll, wie die sachkritischen und fachlich bewanderten Stimmen, dem Rufen und Schreien der geifernden Masse (‚tschuldigung) entgegentreten sollen, ohne ungehört zu bleiben?

Kurz: Wie soll verhindert werden, dass zu viele Köche den Brei verderben? (Oder besser: Wie sollen die vielen Köche diesen angebrannten und versalzenen Brei noch retten?)

Fazit zur Charta der digitalen Grundrechte.

Prinzipiell eine gute Idee. Aber angesichts dessen, was derzeit der Stand der Dinge ist, kann man nur hoffen, dass sich diese Charta irgendwie wieder selbst zerlegt. Dass die Charta sich neu erfindet, wie Phönix aus der Asche steigt und einen Sinn ergibt, vermag ich – aus den vorgenannten Gründen – nicht zu glauben.

Ich fürchte eher, dass das ganze „Verfahren“ zu einem Vorbild mutiert, nach welchem Partizipation und Gesetzgebungsverfahren als lustige, pr-trächtige Spielwiese betrachtet werden – und nicht mehr. Etwas, was man mal machen kann, um maximale Aufregung zu generieren. Aber nicht um wirklich Lösungen zu generieren (Denn wie es immer ist, das ist dann doch eine Ecke komplizierter, als es vorerst aussieht). Das wäre sehr traurig. Und zum Fürchten.

[Wenn ich mit alldem Unrecht haben sollte, dann freue ich mich. Und lasse mich gerne eines Besseren belehren.]

Was das eine mit dem anderen zu tun hat

Soviel zu Big Data. So ein langer Ausflug zur #digitalcharta. Und was hat jetzt das eine mit dem anderen zu tun?

Mit den Ausführungen zu Big Data Analysen wollte ich anhand eines Bereiches aufzeigen, dass wir leider immer noch weit davon entfernt sind, praktische rechtliche Lösungen für real-existierende Technologien und damit einhergehende Probleme zu haben. Gleiches gilt für die KI oder die Frage des Eigentums an Daten. Es sind keine Lösungen in Sicht. In allen diesen Feldern wird zu wenig laut gedacht. Zu wenig diskutiert. Zu wenig Druck gemacht. Und für das, was unter dem Schlagwort Hatespeech diskutiert wird, gibt es zwar schon lange rechtliche Lösungen – aber hier schafft es keiner diese praktisch durchzusetzen. Also, auch ein Grund mal fundiert drüber zu reden.

Insoweit ist es richtig, sich um das digitale Recht Gedanken zu machen. Sehr sogar. Und dringend muss in einer viel breiteren Masse ankommen, dass diese Gedanken wichtig sind. Dass Regelungen zum Datenschutz und zu IT-Sicherheit keine unsinnige Spökenkiekerei von ein paar Nerds sind; es muss klar sein, dass diese Themen, genau wie „Hatespeech“, alle betreffen. (Hier hat der „Bomben“-Artikel geholfen – vermutlich nur mal wieder eher kurz- als langfristig).

Ich bin mir (fast) sicher, dass das auch der tragende Gedanke hinter der #digitalcharta war. Doch wir brauchen so vieles, aber in sich unstimmige digitale Grundrechte losgelöst von jeglicher Gesetzessystematik ohne Blick nach rechts und nach links braucht niemand. Hier wird ein Scheinriese bekämpft. Und das macht mich so wütend. Denn hier wird viel Zeit, Geld und Ressource in einen unbrauchbaren Entwurf für ein Scheinproblem gesteckt. Ein Entwurf, der so schlecht ist, dass man gar nicht weiß, wo man anfangen soll, bei dem man aber vor allem eben überhaupt nicht weiß, warum er denn neben der EU-Grundrechtecharta und der DSGVO überhaupt aus der Taufe gehoben wurde.

Das sind Zeit, Geld und Ressourcen, die wieder einmal an anderer Stelle fehlen. Wo die fehlen, das habe ich faktisch oben schon aufgeführt, aber hier noch einmal etwas allgemeiner:

- Es gibt keine klaren Regelungen, Prüfschemata und Bewertungsmöglichkeiten für real-existierende Technologien (Big Data Analysen/KI/Dateneigentum/setzedieReihebeliebigfort)

- Solche Regelungen muss es aber wenigstens europaweit geben, wenn wir ein einheitliches digitales Rechtsschutzniveau erhalten wollen, dass stark genug ist, ebenso den Einzelnen zu schützen als auch durch einen einheitlichen Regelungsrahmen etwa der USA u.a. die Stirn zu bieten (Ja, ich weiß, dass das Glasfaserkabel nicht an der Grenze stoppt – nächstes Problem). Ach so, ich sagte extra „digitales Rechtsschutzniveau“, nicht Datenschutzniveau. Es geht eben bei weitem nicht nur um Datenschutz.

- Wir brauchen eine Exekutive für die Durchsetzung dieser Regelungen! Derzeit werden Regelungen über Regelungen erschaffen, angedacht, was-weiß-ich und es ist ein offenes Geheimnis, dass all diese digitalen rechtlichen Verpflichtungen, die Unternehmen und Personen untereinander und/oder gegenüber/vom Staat auferlegt werden, überhaupt nicht nachverfolgt werden (können). Und dabei ist es gleichgültig, ob man sich die materielle wie personelle Ausstattung eines „digitalen Polizeireviers“ (wie es so schön heißt), der entsprechenden Staatsanwaltschaften oder aber der zuständigen Datenschutzbehörde einmal ansieht (Ja, ja. Behörden sind nicht nur der „böse Staat“, sie schützen durchaus auch den Einzelnen… ).

Das sind die Dinge, um die man sich Gedanken machen muss. Und darum, wie man dies in die Breite und die Köpfe der Bevölkerung bekommt. Dafür braucht man die breite Diskussion, ja, ja und nochmals ja. Aber nicht, um mit der Energie dann einen Scheinriesen namens Digitalcharta zu füttern.

In diesem Sinne,

bis zur nächsten Runde!